常識的な知恵はこう言います:「自分のデータが使われるのを望まないなら、すべてから身を引け」と。

私たちはこう言います: 「あなたのデータがいずれにせよ収集されるのであれば、その使用方法に影響を与える方が合理的である」

「企業は私のデータを持つべきか?」ではない(すでに持っている)。

本当の質問はこうだ: 「私のデータは、すべての人にとってより優れたAIの構築に貢献すべきか?」

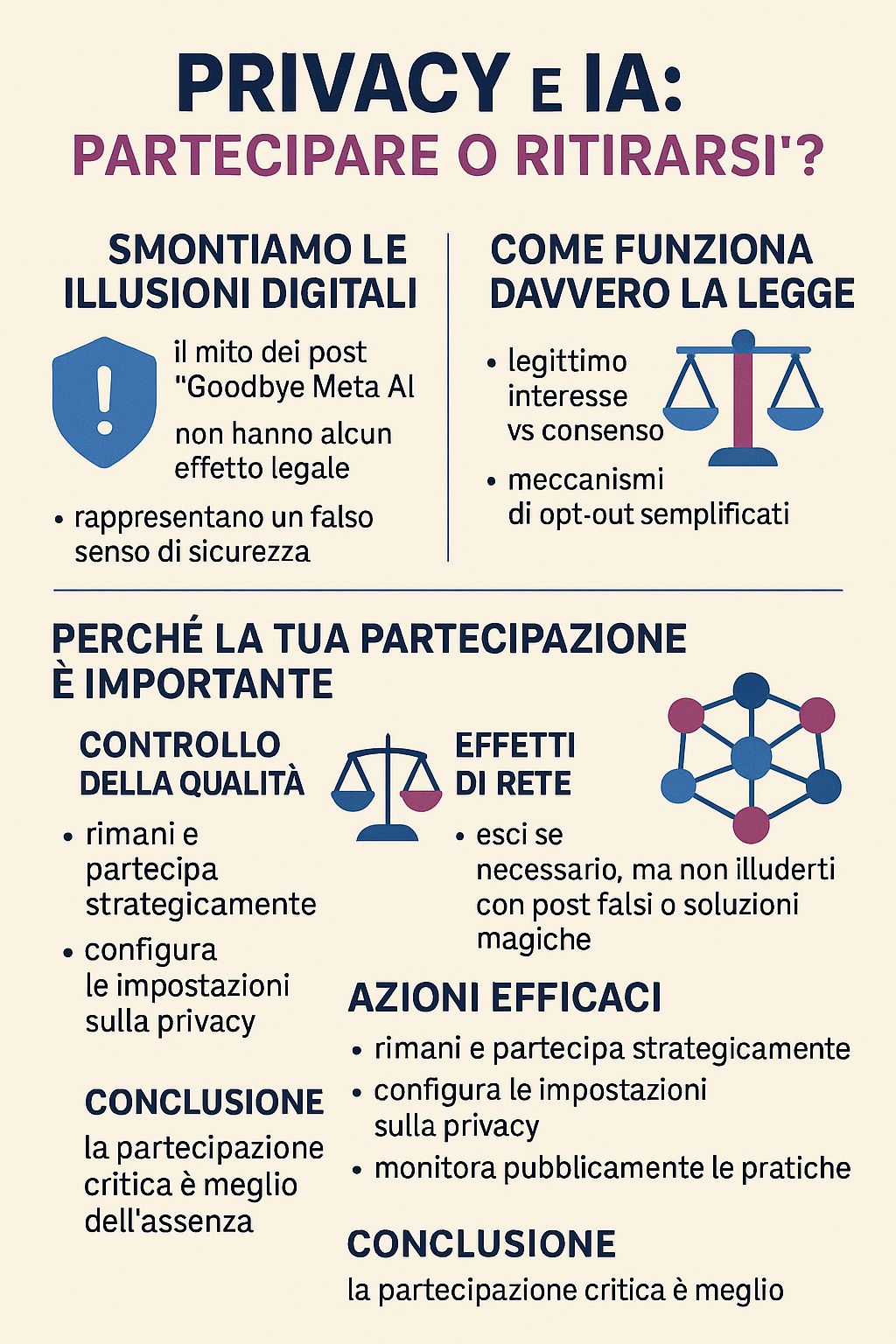

真剣な議論を構築する前に、ソーシャルメディア上で流布している危険な幻想を解体することが不可欠です。それは、メッセージを共有するだけでデータを保護すると約束する「Goodbye Meta AI」というバイラル投稿です。

不都合な真実:これらの投稿は完全に偽物であり、あなたをより脆弱にする可能性があります。

Meta自身が説明しているように、「『Goodbye Meta AI』というメッセージを共有することは、有効な反対の手段とはみなされません」。これらの投稿は:

これらの投稿がバイラルで成功したことは、より深い問題を示しています。私たちは、複雑で情報に基づいた決定よりも、単純で幻想的な解決策を好むのです。投稿を共有することで、デジタル権利が実際にどのように機能するかを理解する労力を必要とせずに、自分たちが積極的に行動していると感じられるのです。

しかし、プライバシーはミームで守るものではない。知識と意識的な行動によって守るのだ。

2025年5月31日より、Metaは、同意ではなく「正当な利益」を法的根拠として、AIのトレーニングに関する新しい制度を導入しました。これは抜け道ではなく、GDPRで規定されている法的手段です。

正当な利益により、企業は、自社の利益がユーザーの権利に優先しないことを証明できる場合、明示的な同意なしにデータを処理することができます。これにより、企業が内部評価を通じて「法律を都合よく解釈する」というグレーゾーンが生まれます。

非匿名化されたデータの使用は、「モデル逆転、記憶漏洩、抽出脆弱性」のリスクが高い。必要な計算能力は、非常に高い能力を持つ主体のみがこれらのデータを効果的に活用できることを意味し、市民と大企業との間に体系的な非対称性を生み出す。

法的および技術的な現実を明らかにしたところで、戦略的参加の論拠を構築しましょう。

意識のある人々が諦めると、AIは残った人々を学習対象とします。AIシステムが主に、次のような人々のデータに基づいて構築されることを望みますか:

AIにおける偏見は、トレーニングデータが代表性を欠いている場合に発生します。あなたの参加は以下を保証するのに貢献します:

AIシステムは、規模と多様性によって向上します:

AIベースの機能(検索、翻訳、おすすめ、アクセシビリティツール)をご利用いただくと、そのご利用が、将来的に最も必要とするユーザーを含むすべての人々のために、これらの機能を改善する一助となります。

AIのオプトインとオプトアウトの間で、あなたのプライバシーは大きく変わりません。同じデータがすでに活用されています:

違いは、これらのデータがすべての人のためのAIの改善にも貢献するのか、それともプラットフォームの即時の商業的利益のみに役立つのかという点です。

まさにこれが、あなたのような責任ある人々が参加すべき理由です。撤退してもAIの開発は止まりません。ただ、あなたの声がその開発から排除されるだけです。

AIシステムはいずれにせよ開発されるでしょう。問題は、こうした問題について批判的に考察する人々の貢献の有無です。

理解できます。しかし、次のことを考えてみてください。AIシステムは、大企業に対するあなたの懐疑的な見解を共有する人々の貢献の有無にかかわらず、構築されるべきだと思いますか?

あなたの不信感こそが、あなたの批判的な参加が貴重である理由なのです。

人工知能は、あなたが参加するかどうかにかかわらず、現実のものになりつつあります。

あなたの選択は、AIが構築されるかどうかではなく、構築されるAIが、これらの問題を慎重に考える人々の価値観や視点を反映するかどうかです。

オプトアウトすることは投票しないことと同じです。選挙を止めるわけではなく、単に結果にあなたの貢献が反映されないという意味です。

高度な計算能力を持つプレイヤーだけがこれらのデータを解釈し効果的に活用できる世界では、トレーニングにおけるあなたの批判的な意見は、あなたの不在よりも大きな影響力を持つ可能性があります。

以下の場合は、戦略的に留まり参加してください:

そしてその間:

しかし、次のような幻想を抱かないでください:

あなたの個別の辞退はプライバシーにほとんど影響しませんが、残留は全員に実際の影響を与えます。

AIシステムが情報の流れ、意思決定、人とテクノロジーの相互作用を決定する世界において、問題はこうしたシステムが存在するべきかどうかではなく、あなたのような思慮深く批判的な人々の視点を取り入れるべきかどうかです。

時には、最も過激な行動は諦めることではない。多くの場合、最も過激な方法は留まり、自分の声が確実に届くようにすることである。

匿名

企業を盲目的に信頼したり、プライバシーに関する懸念を無視したりすることではありません。プライバシーはミームで守るのではなく、戦略的で意識的な参加によって守るものであることを認識することです。

権力の不均衡が甚大なエコシステムにおいて、AIの訓練におけるあなたの批判的な声は、抗議の欠席よりも大きな影響力を持つ可能性があります。

どんな選択をするにしても、デジタルな幻想ではなく、意識的に選択してください。

「プライバシーの隠者」たちへの同情の念も込めて―2025年のチベットの僧侶のようにオフラインで生活することで、デジタル追跡から完全に逃れられると信じている純粋な魂たちへの。

ネタバレ:たとえドロミテの山奥の小屋に住んだとしても、あなたのデータはすでに至る所に存在しています。かかりつけの医師はデジタルシステムを使用しています。薪を購入するための貯金を預けている銀行は、すべての取引を追跡しています。村のスーパーマーケットにはカメラと電子決済システムが設置されています。請求書をお届けする郵便配達員でさえ、最適化アルゴリズムに情報を提供する物流データセットに貢献しています。

2025年に完全なデジタル隠遁生活を送るということは、本質的に市民社会から自らを排除することを意味します。Instagramは断念できても、医療、銀行、教育、労働のシステムを断念することは、生活の質に深刻な影響を及ぼすため不可能です。

あなたが5G対策の小屋を建てている間も、あなたのデータは病院、銀行、保険会社、自治体、税務署のデータベースに存在し続け、将来の世代に影響を与えるシステムの訓練に依然として使用されています。

隠者のパラドックス:抗議的な孤立は、AIシステムが意識の低い人々のデータで訓練されるのを防ぐことはできないが、より倫理的な方向へその開発に影響を与える可能性からあなたを排除する。

要するに、君は歴史をスタンドから眺める者の、汚れのない道徳的純粋さを手に入れたんだ。一方で、君より賢くはないけど、もっと現実的な連中が、ゲームのルールを決めているんだ。

どんな選択をするにしても、デジタルな幻想ではなく、意識的に選択してください。

引用記事:

GDPRと正当な利益に関する詳細情報:

公式リソース:

具体的な行動:ヨーロッパにお住まいの場合は、プライバシー保護機関で公式のオプトアウト手続きを確認してください。一般的な情報については、ご利用のプラットフォームのプライバシー設定および利用規約をご覧ください。なお、ソーシャルメディア上の投稿には法的効力はありませんのでご注意ください。